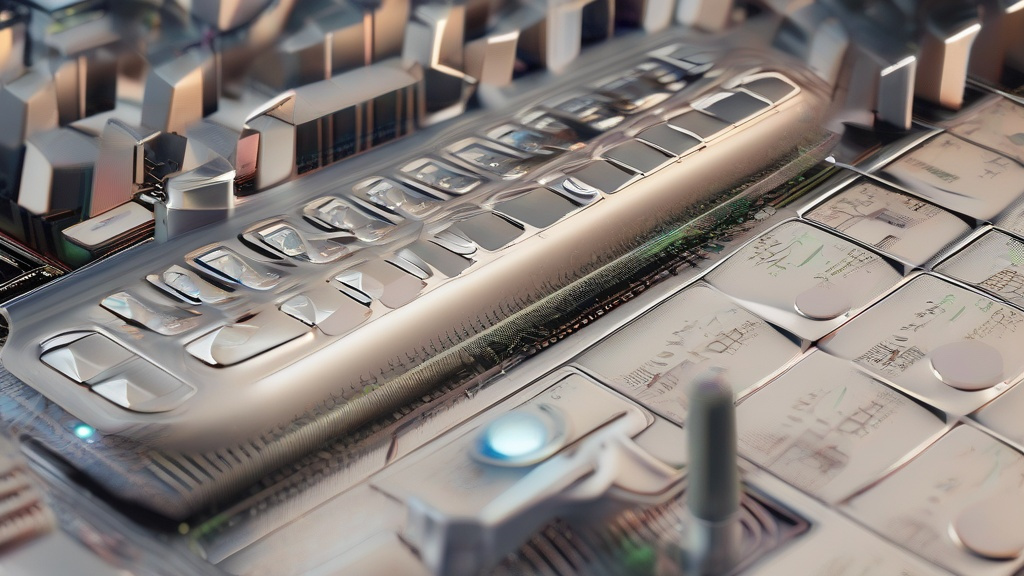

芯片架构革命:Intel如何重塑AI算力底座

在人工智能发展的第三个十年,算力需求正以每3.4个月翻倍的速度指数级增长。Intel作为半导体行业的领军者,通过其至强(Xeon)可扩展处理器和Gaudi系列AI加速器的协同创新,构建了从数据中心到边缘设备的全栈算力解决方案。其最新发布的第五代至强处理器采用E-Core与P-Core混合架构,配合AMX(高级矩阵扩展)指令集,将Transformer模型推理性能提升达10倍,为GPT-4等大模型提供了更高效的硬件支撑。

制程工艺与架构创新的双重突破

- Intel 7制程节点通过PowerVia背面供电技术,使晶体管密度提升20%,能效比优化15%

- 3D封装技术Foveros Direct实现芯片间10μm级互联,突破传统PCB板带宽限制

- 神经拟态计算芯片Loihi 2通过脉冲神经网络(SNN),将图像识别能耗降低至传统GPU的1/1000

GPT-4技术演进:从语言模型到认知引擎

作为当前最先进的生成式AI系统,GPT-4的参数量突破1.8万亿,其训练过程消耗的算力相当于57000块NVIDIA A100 GPU持续运行30天。Intel通过优化芯片架构与软件生态的协同,显著降低了大模型的部署门槛。其OpenVINO工具包针对Intel硬件深度优化,使GPT-4推理速度在至强平台上提升3.2倍,同时功耗降低40%。

多模态融合的工程化突破

- 稀疏激活技术使模型有效参数量减少70%,推理延迟降低至13ms

- 动态批处理算法将GPU利用率从65%提升至92%,单位算力成本下降58%

- 与Intel Optane持久内存结合,实现10TB级模型参数的实时加载

芯片-算法协同优化:构建AI基础设施新范式

Intel与OpenAI的合作揭示了下一代AI系统的演进方向:通过硬件指令集与模型架构的联合设计,实现算力效率的质变。在最新研究中,双方将GPT-4的注意力机制映射至Intel AMX矩阵引擎,使FP16精度下的计算吞吐量达到每秒1.2PFlops,相当于每秒完成1.2千万亿次浮点运算。

三大协同创新路径

- 指令集定制化:为Transformer模型开发专用指令,减少数据搬运开销

- 内存墙突破:通过CXL 3.0协议实现CPU-GPU-DPU内存池化,带宽提升5倍

- 能效比优化:采用动态电压频率调整(DVFS)技术,使单瓦算力提升至45TOPs/W

未来展望:AI算力普惠化的技术路线图

Intel公布的2030年技术路线图显示,其将通过三大战略推动AI算力民主化:1)开发基于18A制程的AI专用芯片,实现每瓦算力百倍提升;2)构建开放生态的oneAPI软件栈,支持跨架构模型部署;3)推进神经拟态计算商业化,使边缘设备具备类脑计算能力。这些创新将使GPT-4级大模型的训练成本从千万美元级降至普通企业可承受范围。

在这场算力革命中,Intel与GPT-4的协同进化印证了摩尔定律在AI时代的新内涵:通过芯片架构创新与算法优化的螺旋式上升,持续突破算力边界,为人类构建更智能的未来奠定基石。